1. 서 론

2. 시료 및 실험방법

2.1. 시료 및 선별실험

2.2. 학습 모델링 구축

2.3. 윤곽선 검출 분석

2.4. 선별률 예측 및 입자 데이터 분석

3. 실험 결과

3.1. 학습 모델링 구축

3.2. 윤곽선 검출 분석

3.3. 선별 실험 및 영상인식 데이터 비교 분석

4. 결 론

1. 서 론

최근 탄소중립과 자원순환에 대한 전 세계적인 관심이 고조되면서, 폐기물 자원 재활용은 자원 보존과 환경 보호를 위해 반드시 해결해야 할 핵심 과제로 인식되고 있음. 특히 폐배터리와 폐태양광 모듈과 같이 복합 재질로 구성된 산업계 폐기물은 단순한 폐기물이 아니라, 유가금속, 희소자원, 고분자 물질 등 회수가능한 고부가가치 성분을 다수 포함하고 있어 재활용을 통한 자원 회수의 필요성이 더욱 강조되고 있다1).

복합 폐기물의 경우 파쇄 및 선별 이후에도 구성 성분의 이질성이 매우 크며, 이에 따라 선별 산물의 상태를 체계적으로 분석할 수 있는 표준화된 방법이 부재하다. 폐배터리나 태양광 모듈 같은 복합 소재 폐기물은 금속, 플라스틱, 바인더, 유리 등 다양한 성분이 혼재되어 있으나, 기존 연구에서 주로 이용된 SEM‑EDS, XRF, XRD, AAS 등의 실험실 기반 장비들은 정밀한 분석이 가능하지만, 분석 장비에 맞는 시료 조건을 따로 준비해 주어야 하며, 분석 이후 결과가 나오는 시간이 걸리기 때문에 실시간 또는 현장 적용이 가능한 분석법 도입이 어려운 실정이다2). 선별이 끝난 후 산물에 대한 정보가 부족하면 공정을 효율적으로 운영하거나 자동화하는 데 어려움이 생긴다. 따라서 현장에서 빠르고 정확하게 분석할 수 있는 방법을 개발하는 것이 꼭 필요하다.

이러한 대안으로 최근 주목받고 있는 것이 영상인식 기법을 이용한 폐기물 원료 선별이다. 그 중 가장 활발하게 다루고 있는 연구는 YOLO 기법을 이용한 영상인식 기법이다. YOLOv8 모델을 기반으로 한 폐기물 분류 연구는 최근 다양한 응용 분야에서 활발히 진행되고 있다. Arishi (2025)는 SE 및 CBAM 주의 메커니즘을 YOLOv8에 결합한 네트워크 구조를 제안하여, 가정 내 생활 폐기물의 실시간 분류 성능을 향상시켰으며, 특히 크기가 작은 폐기물에 대한 탐지 정확도를 효과적으로 개선하였다3). 산업 현장을 대상으로 한 연구로는 Zhou et al.(2024)가 있으며, 이들은 재활용 공정에서 발생하는 폐기물의 분류를 위해 YOLOv8 기반 객체 인식 모델에 pyramid 구조를 적용하여 기존 방식 대비 향상된 성능을 보고하였다4). Rajeev et al.(2025) 역시 CSPDarknet을 백본으로 하는 YOLOv8 모델을 구성하고, 이를 실시간 자동화 관리 시스템과의 연계 가능성 측면에서 평가하였다5). 한편, Mehadjbia and Slaoui-Hasnaoui(2024)는 아동 교육용 영상인식 시스템 개발에 YOLOv8 모델을 도입하였으며, TrashNet 기반 데이터셋의 클래스 불균형 문제를 개선하여 다양한 폐기물 이미지를 효과적으로 분류할 수 있는 모델을 구현하였다6).

이와 같이 기존 연구들은 주로 YOLOv8의 실시간 객체 인식 성능을 활용하여 폐기물 분류 정확도를 향상시키는 데 기여하고 있으며, 재활용 공정의 자동화 기술 실현을 위한 기초적 기반을 제공하고 있다. 그러나 대부분의 사례는 폐기물을 원물 단위로 분류하는 데 집중되어 있으며, 입자 단위의 재질 식별이나 영상 기반 입자 특성 분석을 통한 실시간 공정 모니터링 등 후단 공정 중심의 접근은 상대적으로 미흡한 실정이다.

따라서 본 연구에서는 선별 이후 입자 단위 산물의 물리적 특성과 조성 상태를 효과적으로 분석하기 위한 대안으로 영상인식 기술을 도입하였다. 영상인식은 다양한 입자의 크기, 형태, 색상, 분포 특성을 실시간으로 감지할 수 있어, 기존의 분석 장비들이 가지는 시간적·경제적 한계를 보완할 수 있다. 또한 이미지 기반 데이터는 반복성과 자동화에 유리하므로, 선별 공정 후 산물의 품질 모니터링 및 피드백 제어에 적용 가능성이 높다. 이를 통해 공정 전반의 효율성을 높일 수 있는 가능성을 파악하고자 하였다.

2. 시료 및 실험방법

2.1. 시료 및 선별실험

본 연구에서는 폐배터리 파쇄물을 이용하여 선별실험을 수행하였고, 이때 획득된 데이터를 영상인식 가능성 평가의 기준 데이터로 활용하였다. 실험에 사용된 시료는 배터리 재활용 업체로부터 제공받았으며, 이는 슈레더를 이용한 1차 파쇄 후, 선별실험에 적합하도록 스크린이 설치되지 않은 Cutting mill을 통해 2차 파쇄 과정을 거친 입자이다. 시료의 입도 분포는 Table 1에, 시료의 외형은 Fig. 1에 제시하였다. 에어 지그재그 선별기(Fig. 2를 이용한 선별 실험은 각각의 풍속 조건(10 m3/h 및 20 m3/h)에서 수행하였다. 10 m3/h 조건에서는 분리막이 Overflow로, 20 m3/h 조건에서는 전극 및 파우치가 Overflow로 분리되었으며, 플라스틱은 주로 Underflow로 배출되었다7).

Table 1

Particle size distribution of the main components

2.2. 학습 모델링 구축

영상인식에 사용된 이미지 데이터는 각 재질을 무작위로 배열한 상태에서 촬영되었다. 객체 인식 학습을 위한 객체 인식 학습을 위한 데이터셋은 전량 수동 라벨링을 통해 구축되었으며, YOLO 포맷에 맞춰 약 7,000개의 라벨링 데이터를 생성하였다. 이 중 약 6,000개의 객체는 학습에, 1,000개는 검증에 활용되었다. 학습 모델은 Python 환경에서 구현되었으며, 영상 기반 딥러닝 처리를 위해 다양한 오픈소스 라이브러리와 프레임워크를 기반으로 구성되었다. 특히, YOLOv8 모델은 Ultralytics 라이브러리를 활용하여 사전 학습된 가중치(pre-trained weight)를 불러온 뒤, 폐기물 이미지 내 객체의 클래스 및 위치를 실시간으로 탐지할 수 있도록 설계되었다. 검출된 객체는 클래스별로 분류되어, 이후 선별률 분석 및 공정 모니터링에 활용될 수 있도록 처리되었다.

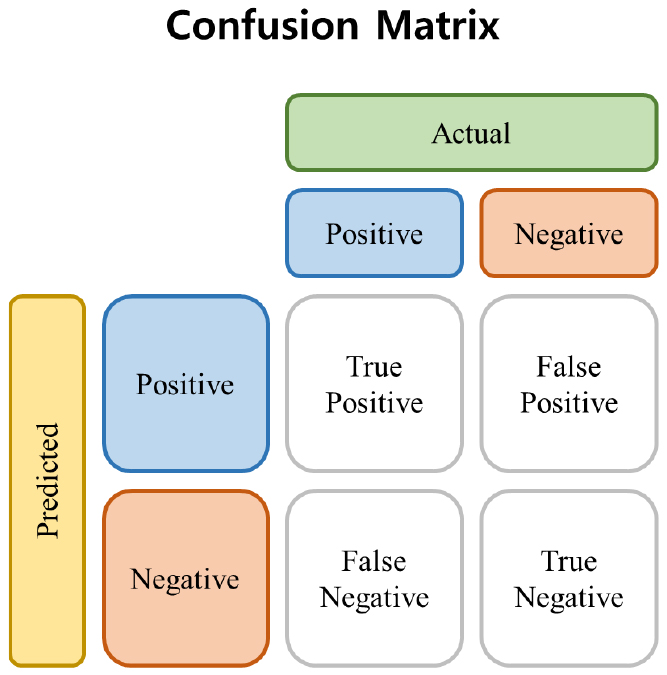

학습된 모델의 성능을 검증하기 위해 학습 과정에서의 총 손실값(total loss) 변화를 확인하였다. 총 손실값은 경계 상자의 위치 및 크기 오차(box loss), 객체 존재 유무에 대한 오차(objectness loss), 클래스 분류 오차(class loss)로 구성된다. 또한, 객체 검출 정확도 평가는 대표적인 지표인 평균 정밀도(mean average precision, mAP)를 활용하여 수행하였다. mAP는 객체 탐지 모델의 전반적인 인식 성능을 종합적으로 판단할 수 있는 지표로, Precision(정밀도)과 Recall(재현율)을 기반으로 산출된다. Precision은 모델이 검출한 전체 객체 중 실제 정답과 일치하는 객체의 비율을 의미하며, 다음과 같이 정의된다.

여기서 TP(True Positive)는 모델이 올바르게 검출한 객체 수, FP(False Positive)는 모델이 잘못 검출한 객체 수를 의미한다. 반면, Recall은 전체 정답 객체 중 모델이 올바르게 탐지한 비율로, 다음과 같이 정의된다.

여기서 FN(False Negative)은 정답 객체 중 올바르게 인식되지 못한 객체 수를 의미한다. Fig. 3에 제시된 Confusion Matrix는 TP, FP, FN 등의 예측 결과를 행렬 형태로 시각화한 것으로, 모델의 분류 성능을 직관적으로 확인할 수 있도록 한다. 또한, Average Precision(AP)은 Precision-Recall 곡선 하단의 면적을 적분하여 산출된 값으로, 각 클래스별 인식 성능을 수치적으로 평가한다. 마지막으로, mAP는 전체 클래스에 대해 계산된 AP 값을 평균하여 도출되며, 이는 다중 클래스 객체 탐지 모델의 전반적인 인식 정확도를 나타내는 핵심 성능 지표로 활용된다.

2.3. 윤곽선 검출 분석

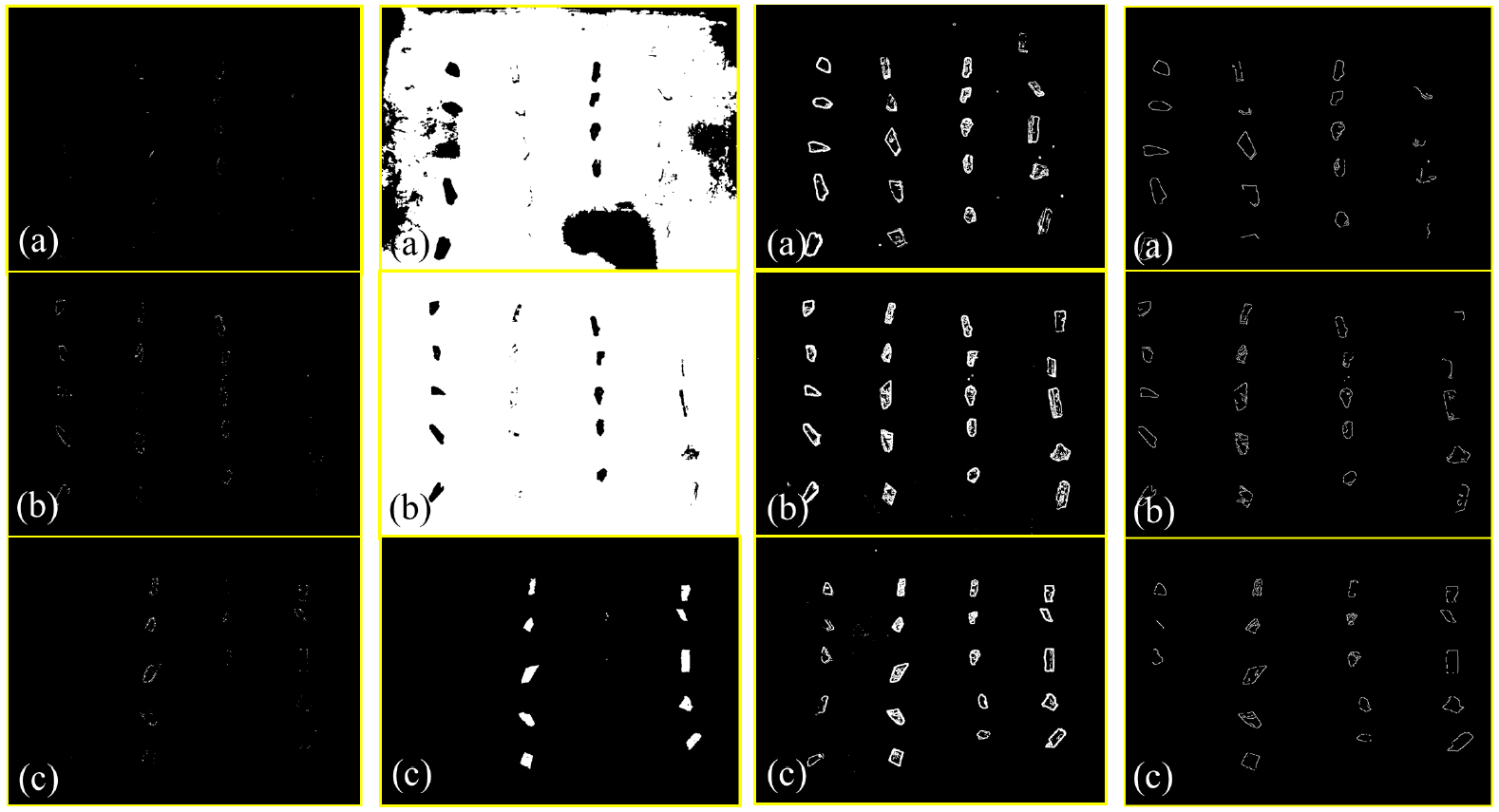

본 연구에서는 윤곽선 검출 알고리즘을 기반으로 객체의 외곽을 인식하고 이를 정량적으로 측정하였다. 이를 위해 윤곽선 기법인 Thresholding, Laplacian, Sobel, Canny edge detection 알고리즘을 비교 분석하였으며, 실험 결과를 바탕으로 최적의 알고리즘을 선정하였다. 각 알고리즘의 파라미터는 OpenCV 라이브러리에서 제공하는 기본값을 적용하였으며, 이는 다양한 영상 조건에서도 안정적인 성능을 보인다는 선행 연구들을 기반으로 결정되었다8,9).

각 알고리즘의 검출 성능을 다양한 환경에서 비교하기 위해, 금속성 재질의 표면과 흰색 및 검은색 배경을 각각 적용한 실험 환경을 구성하여 윤곽선 검출 결과를 분석하였다. 모든 실험은 동일한 해상도(1920×1080)의 RGB 이미지를 대상으로 수행되었으며, 알고리즘 적용 전에는 grayscale 변환을 통해 색상 정보를 단일 채널로 처리하였다. 이후 Gaussian Blur(kernel size: 5×5, σ = 0)를 적용하여 영상 내 노이즈를 제거하고, 윤곽선 검출 시 발생할 수 있는 오류를 최소화하였다. 각 알고리즘의 검출 결과는 동일한 Region of Interest(ROI)를 기준으로 분석하였으며, 검출된 윤곽선의 연속성과 정확도를 중심으로 성능을 비교하였다10).

윤곽선 검출 실험 이후 가장 성능이 좋은 기법에 대한 실용성을 파악하기 위해 윤곽선 검출 성능 분석에 일반적으로 사용되는 세 가지 지표인 IoU(Intersection over Union), F1 Score, HD(Hausdorff Distance)를 이용하여 성능을 검증하였다. IoU는 정답 윤곽선과 예측 윤곽선 사이의 겹치는 면적 비율을 측정하는 지표로, 값이 1에 가까울수록 두 윤곽선이 거의 일치함을 의미한다. 일반적으로 IoU가 0.5 이상일 경우 기본적인 검출 성능을 확보한 것으로 간주된다. F1 Score는 정밀도(Precision)와 재현율(Recall)의 조화 평균으로, 두 지표 간의 균형을 수치화하여 평가한다. 값이 1에 가까울수록 검출의 신뢰도가 높은 것으로 해석된다. HD는 정답 윤곽선과 예측 윤곽선 간의 최대 거리 차이를 측정하는 지표로, 각각의 점에서 가장 가까운 상대 윤곽선 점까지의 거리 중 최대값을 기준으로 평가된다. 이 값이 작을수록 두 윤곽선 간 형상 차이가 적다는 것을 의미한다.

2.4. 선별률 예측 및 입자 데이터 분석

학습 모델을 통해 입자의 재질을 분류하였으며, 윤곽선 검출 기법과 기준선 보정 알고리즘을 이용하여 입자의 면적을 측정하였다. 이후 각 입자별 단위 면적당 질량의 평균값을 측정하였으며, 입자의 면적값에 적용하여 입자의 질량 데이터를 산출하였다(식 (3)).

산출된 질량 데이터를 통해 각 재질별 회수율 및 순도를 파악하였으며, 실제 회수율 및 순도 데이터와 정합률을 구해 데이터의 신뢰도를 확인하였다. 각 재질별로 영상 기반 계산값과 실측값을 병렬적으로 비교하여 회수율(Recovery), 순도(Grade) 항목에 대한 정량적 차이를 분석하였다. 회수율의 경우, 투입된 총 질량과 선별된 질량에 대한 비율을 통해 측정하였으며, 순도의 경우 선별된 총 질량 중 해당 재질의 질량 비율을 통해 산출하였다(식 (4), 식 (5)).

실측값은 선별 실험 후 수작업 계수를 기반으로 산정한 실제 회수 데이터를 기준으로 하였으며, 이는 비교 기준의 정확성을 확보하기 위함이다. 본 연구에서는 이러한 비교를 통해 영상 기반 계산값이 실제 회수 성능을 얼마나 정확히 반영하는지를 평가하고, 제안된 알고리즘 기반 선별률 산정 방식의 실효성을 검증하고자 하였다. 이를 위해 계산값과 실측값 간의 평균 정합률을 산출하였으며, 표준 통계 지표 중 하나인 평균 절대 백분율 오차(MAPE, Mean Absolute Percentage Error)를 변형하여 활용하였다. 해당 지표는 각 항목별 오차의 절대값을 비율로 환산하고, 이를 평균함으로써 정량적 오차 수준을 종합적으로 평가할 수 있다.

식 (6)은 전체 비교 항목 수 n=12일 때의 평균 절대 백분율 오차(MAPE, Mean Absolute Percentage Error) 계산식으로, 각 항목에 대한 평균 오차율을 산출할 수 있다. 그러나 본 연구의 목적은 오차율 자체보다는 계산값과 실측값 간의 일치 정도를 수치적으로 확인하는 데 있으며, 이에 따라 정합률(Agreement Rate)을 기준으로 하는 새로운 평가 지표가 필요하였다. 따라서 식 (6)을 변형하여, 평균 정합률을 산출할 수 있도록 식 (7)을 정의하였다. 이 식은 기존 MAPE의 오차 중심 개념을 반전시켜, 정합도를 백분율로 표현함으로써 영상 기반 계산값의 신뢰도를 보다 직관적으로 평가할 수 있도록 하였다.

본 연구에서 활용한 실측값 데이터에는 0 또는 0에 매우 근접한 값이 포함되어 있어, 이를 식 (7)에 직접 적용할 경우 정합률이 음수로 계산되거나 100%를 초과하는 비정상적인 결과가 발생할 수 있다. 이러한 오류를 방지하고, 정합률 계산의 수학적 안정성을 확보하기 위해, 본 연구에서는 식 (7)에 max(실측값 i ,1)을 분모로 적용하였다. 이를 통해 실측값이 0이거나 1 이하의 값인 경우에도 정합률을 정상적으로 산출할 수 있도록 하였으며, 결과적으로 전체 데이터에 대한 일관된 정량 평가가 가능하도록 하였다.

식 (8)을 직접 적용할 경우, 실측값과 예측값 간의 차이가 큰 경우 정합률이 음수로 계산되는 등의 오류가 발생할 수 있다. 이러한 문제를 보완하기 위해, 본 연구에서는 식 (8)의 분모에 max(실측값 i,예측값 i)을 적용하여 정합률이 항상 0 이상으로 산출되도록 계산식을 수정하였다. 이를 통해 극단적인 오차 상황에서도 수치적 안정성을 확보하고, 정합률의 해석 가능성을 높일 수 있었다.

식 (9)를 이용할 시 예측값 또는 실측값 중 어느 하나가 0의 값을 가질 경우, 정합률 계산에서 오류가 발생하는 문제가 있으므로 0의 값을 포함하는 항목에 대해서는 예외적으로 식 (8)을 이용하여 정합률을 산정하였다.

3. 실험 결과

3.1. 학습 모델링 구축

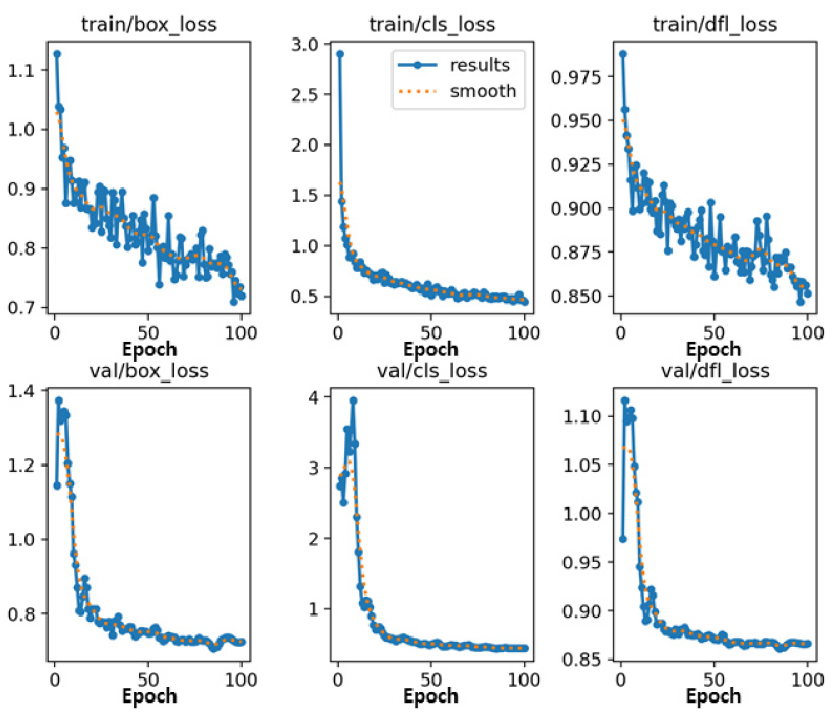

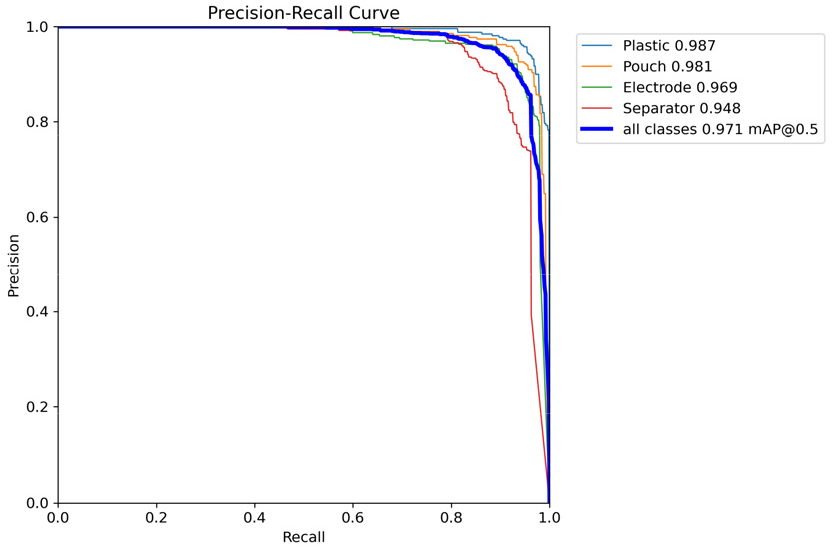

본 연구에서는 수동 라벨링 방식을 통해 학습용 데이터셋을 구축하였다. 초기 학습은 총 100 epoch 동안 진행되었으며, 여기서 epoch은 전체 학습 데이터가 모델에 한 차례 모두 입력되어 학습되는 단위를 의미한다. 학습이 진행됨에 따라 모든 손실값(Loss)이 점차 감소하는 경향을 보였으며, Fig. 4에 해당 변화 양상을 epoch별로 도시하였다. 학습 결과, mAP50 기준 0.971의 성능을 갖는 객체 인식 모델이 구축되었으며, Fig. 5를 통해 학습 결과를 확인할 수 있다. 일반적으로 YOLO 기반 객체 탐지 모델은 검증 데이터에 대해 배경, 조명, 입자 배치 등 다양한 조건을 무작위로 구성하여 평가를 수행하므로, mAP 수치가 약 50% 수준에서 나타나는 것이 일반적이다. 이는 복잡하고 예측 불가능한 실제 환경에서도 일정 수준 이상의 인식률을 유지한다는 점에서 실용적 신뢰도가 확보된 결과로 해석할 수 있다. mAP 80% 이상은 통상적으로 정제된 데이터셋 또는 고정된 환경에서만 달성 가능한 수치로, 본 실험 조건을 고려할 때 mAP 0.971는 매우 우수한 결과로 평가된다. 따라서 본 모델은 실제 환경에 적용 가능한 수준의 인식 성능을 확보한 것으로 판단된다.

3.2. 윤곽선 검출 분석

가장 적합한 윤곽선 검출 알고리즘을 선정하기 위해 대표적인 윤곽선 검출 기법인 Threshold, Laplacian, Sobel, Canny edge 네 가지 알고리즘을 적용하여 실험을 수행하였다. Laplacian 기법은 뚜렷한 경계에서 윤곽선을 잘 검출하는 특성을 가지나, 세 가지 배경 조건 모두에서 연속된 윤곽선을 형성하지 못하는 한계가 확인되었다. 이는 시료의 반사광 및 배경과 유사한 색상을 가진 입자가 존재한 데 기인한 것으로 판단된다. Threshold 기법은 밝기에 매우 민감한 특성을 보였으며, 금속성 배경에서는 반사광으로 인해 밝은색 입자의 윤곽 검출이 어렵고, 흰색 배경에서도 유사한 문제가 나타났다. 반면 검은색 배경에서는 밝은색 입자의 윤곽선이 비교적 잘 검출되었으나, 어두운 색상의 입자에 대해서는 검출 성능이 떨어졌다. Sobel 기법은 대부분의 환경에서 안정적인 윤곽선 검출 성능을 보였으나, 일부 검은색 배경에서는 경계 검출이 미흡한 결과도 관찰되었다. Canny edge 기법 역시 전반적으로 우수한 윤곽선 검출 성능을 보였으며, 다만 Sobel과 마찬가지로 어두운 배경에서 일부 객체의 경계 검출이 제한되는 결과가 나타났다(Fig. 6). 이러한 결과를 바탕으로 Sobel과 Canny edge 두 기법이 상대적으로 높은 성능을 나타내었으며, 두 기법을 대상으로 보정 적용 후 비교 실험을 추가로 수행하였다(Fig. 7).

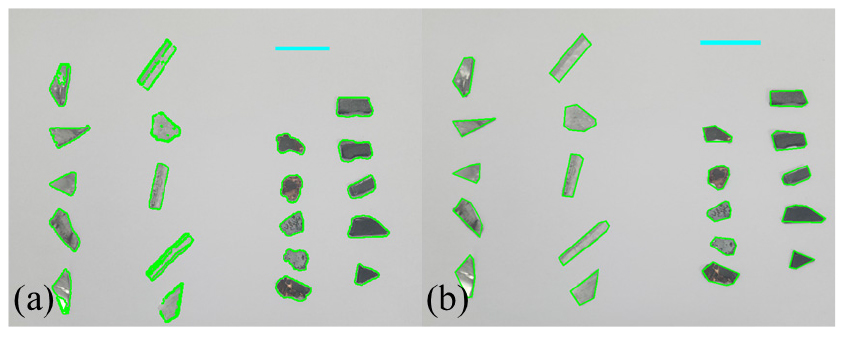

정밀한 윤곽선 계측을 위해 스케일 보정 과정을 포함하였으며, 이는 HSV(Hue, Saturation, Value) 색 공간 변환을 통해 기준선의 색상 영역을 추출하고, 윤곽선 검출 및 허프 변환(Hough Transform)을 통해 기준선의 실제 길이를 계산함으로써 픽셀당 거리(mm/pixel)를 확보하는 방식으로 구현하였다. 보정된 윤곽선 분석 결과, Sobel 필터는 대부분의 입자 경계를 검출하였으나, 어두운 배경에서의 검정색 입자는 경계 구분이 미흡했고, 반사광에 의한 노이즈 발생도 관찰되었다. 반면 Canny edge 기법은 다양한 배경 조건에서도 가장 안정적인 경계 검출 성능을 보였으며, 특히 어두운 배경에서도 입자의 윤곽을 명확하게 인식할 수 있었고 내부 노이즈에 대한 민감도도 낮은 수준으로 유지되었다.

이러한 결과를 종합하면, Canny edge 기법이 본 실험에서 가장 적합한 윤곽선 검출 방법으로 판단된다. 윤곽선 검출 성능 분석 결과는 Table 2에 요약하였다. IoU는 평균 0.88로, 예측 윤곽선이 정답 윤곽선과 높은 수준의 면적 일치도를 보였음을 나타낸다. HD는 평균 18픽셀로 나타났으며, 이는 Muller et al.(2022)의 연구에서 제시한 기준인 20픽셀 이하의 수용 가능한 오차 범위에 해당한다11). 해당 연구에 따르면, HD가 30픽셀 이상일 경우 구조적 오류 가능성을 고려해야 하므로, 본 연구의 결과는 전반적으로 안정적인 형상 일치도를 확보한 것으로 판단된다. 반면 F1 Score는 상대적으로 낮게 산출되었는데, 이는 F1 Score가 픽셀 단위의 정밀한 윤곽 일치를 전제로 계산되기 때문이다. 본 연구는 입자의 형상 검출에 중점을 두고 후처리 보정을 적용하였으며, 이 과정에서 예측 윤곽선이 정답 윤곽선과 부분적으로 어긋나면서 True Positive의 감소로 이어졌고, 결과적으로 F1 Score가 낮게 도출된 것으로 해석된다.

Table 2

Comparison between Canny edge detection results and ground truth data

3.3. 선별 실험 및 영상인식 데이터 비교 분석

윤곽선 검출 결과와 단위 면적당 질량 데이터를 활용하여, 영상 기반의 알고리즘을 통한 선별률 계산 메커니즘을 구축하였다. 단위 면적당 질량 데이터는 각 재질별로 대표 입자 15개에 대해 넓이와 질량을 측정한 후 평균값을 산출하여 도출하였다. 측정 결과, 각 객체의 단위 면적당 질량은 플라스틱 0.0015 g/mm2, 파우치 0.00034 g/mm2, 전극 0.00034 g/mm2, 분리막 0.000028 g/mm2으로 나타났다. 객체 면적은 Canny edge 기반의 윤곽선 검출 알고리즘을 이용하여 산출하였다. 윤곽선 내부의 픽셀 수를 적분 방식으로 계산한 후, 기준선 정보를 활용해 해상도 보정을 수행하고 픽셀당 실제 길이를 적용하여 실면적(mm2)으로 변환하였다. 이후, 각 객체별 단위 면적당 질량 값을 적용하여 객체별 질량을 추정하고, 이를 바탕으로 선별률을 계산하였다. Table 3 및 Table 4는 영상 기반 알고리즘으로 계산된 선별률과 실제 선별 실험을 통해 측정된 실측 선별률 간의 비교 결과를 나타낸다. 계산값은 각 선별 실험 후 촬영한 영상 데이터를 기반으로 객체 인식 및 윤곽선 분석 알고리즘을 적용하여 도출된 결과이며, 이를 통해 영상인식 및 윤곽선 검출 기반 질량 분석의 신뢰성을 파악하였다.

Table 3

Comparison of calculated and experimental data: Recovery

Table 4

Comparison of calculated and experimental data: Grade

정합률 산정에는 식 (6)를 주로 적용하였으며, 각 재질별 회수율 및 순도에 대한 정합률 결과는 분리막의 경우 10 m3/h Over 조건에서 회수율 96.97%, 순도 88.97%로 나타났고, 전극은 20 m3/h Over 조건에서 회수율 99.75%, 순도 97.94%로 매우 높은 정합률을 보였다. 파우치는 동일 조건에서 회수율 99.02%, 순도 97.50%를, 플라스틱은 20 m3/h Under 조건에서 회수율 98.06%, 순도 99.92%를 기록하였다. 이처럼 모든 재질에 대해 회수율은 95% 이상, 순도는 분리막을 제외한 나머지 재질에서 모두 95% 이상으로 확인되었으며, 분리막 또한 90%에 근접한 정합률을 나타냈다. Chen et al.(2003)의 기준에 따르면, MAPE 값이 10% 이하일 경우 매우 우수한 성능, 10% 초과 20% 이하일 경우에도 양호한 수준이다12). 이는 영상 기반 선별 모델의 신뢰도를 뒷받침하는 결과로 평가된다.

4. 결 론

복합 폐기물의 정밀 선별에 대응하기 위해 본 연구에서는 폐배터리 파쇄 시료를 대상으로 에어 지그재그 선별기를 이용한 전처리 공정과 AI 영상인식 기반 객체 탐지 알고리즘을 결합한 자동화 선별 시스템의 적용 가능성을 검토하였다.

에어 지그재그 선별기를 활용하여 시료를 선별한 후, 산출물에 대해 영상 촬영을 수행하고, 이를 AI 기반 객체 인식 알고리즘에 적용함으로써 재질별 입자 식별, 윤곽선 기반 직경 측정, 입도 분포 데이터 추출을 실시하였다. 데이터 분석 결과, 재질별 회수율 및 순도에 대한 정합률은 모든 재질에서 회수율에 대한 정합률은 95% 이상으로 나타났으며, 순도에 대한 정합률 또한 분리막을 제외한 나머지 재질에서 95% 이상을 기록하였다. 분리막의 경우에도 90%에 근접한 수준을 보였으며, 이를 기준으로 본 연구의 정합률은 모든 재질에서 양호한 성능을 확보한 것으로 판단하였다.

이러한 결과는 영상 기반 계산값이 실제 회수 성능을 정량적으로 잘 반영함을 의미하며, 제안된 알고리즘 기반 선별률 산정 방식의 유효성을 뒷받침한다. 본 연구에서는 이러한 분석 결과를 기반으로 영상인식 모델의 보정, 후처리 알고리즘의 개선, 객체 분리 정확도 향상을 위한 기초 피드백 자료로 활용 가능함을 제시하였다. 본 연구 결과는 향후 영상 기반 공정 모니터링 시스템의 신뢰성과 예측 정확도 향상에 중요한 기초 자료로 기여할 수 있을 것으로 판단된다.